文章主题:阿里云, 大规模视觉语言模型, Qwen-VL, 多模态信息理解能力

【亿邦原创】8月25日,我国知名云计算服务商阿里云正式推出了一款全新的视觉语言模型——Qwen-VL。该模型基于通义千问70亿参数模型Qwen-7B进行深度研发,能够支持图文并茂的输入方式,并且具备强大的多模态信息理解能力。

Qwen-VL是一款具备多元语言支持的视觉语言(Vision Language, VL)模型。相较于先前的VL模型,Qwen-VL不仅拥有基本的图文识别、描述、问答以及对话功能,还进一步拓展了其视觉定位和图像中文字理解的能力。这意味着Qwen-VL能够更好地理解和处理多种语言的视觉信息,为各种应用场景提供更加准确和全面的解决方案。

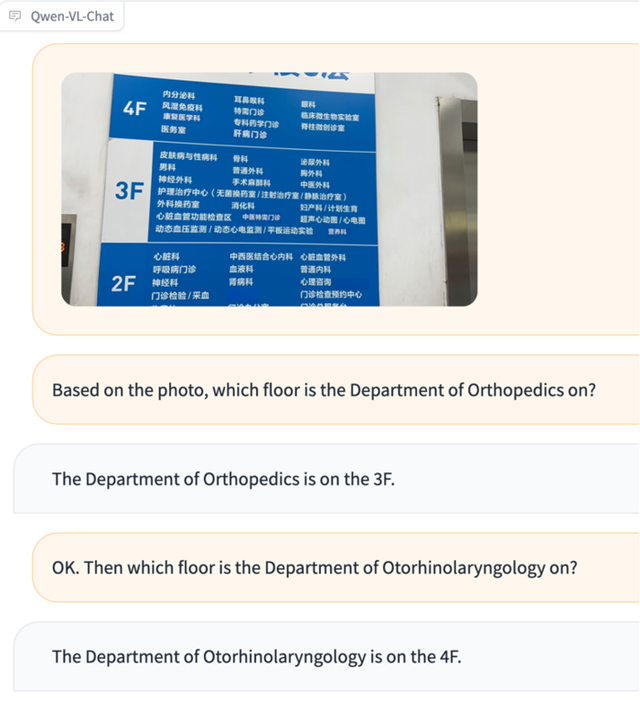

在医疗环境中,例如一个不精通中文的外国游客在面对医院的各种部门时可能会感到困惑。这时,他们可以借助一些智能工具来获取所需的信息。其中,图像识别技术就是一个有效的解决方案。例如,当游客需要找到骨科或耳鼻喉科时,他们可以通过拍照并询问人工智能助手Qwen-VL来获得指引。Qwen-VL能够根据所提供的图片信息,提供详细的文字描述,从而帮助游客快速找到相应的科室。此外,在旅游场景中,人们也可以利用图像识别技术来寻找特定的景点。例如,当游客需要找到上海外滩上的东方明珠时,他们可以上传一张照片,然后让Qwen-VL通过检测框准确地标注出对应的建筑。这种能力不仅可以帮助游客更好地欣赏美景,还可以提高他们的旅行体验。综上所述,图像识别技术在医疗和旅游场景中都发挥着重要作用。通过智能助手的帮助,游客可以更轻松地找到所需的科室和景点,从而提升他们的旅行体验。

Qwen-VL是一款基于Qwen-7B语言模型的产品,它在模型架构上进行了创新性的改进,引入了视觉编码器,从而赋予了模型处理视觉信号的能力。这种设计使得模型能够对视觉信号进行精细化的感知和理解。值得注意的是,Qwen-VL所支持的图像输入分辨率高达448,远高于通常的224分辨率 openai LVLM 模型。基于Qwen-VL的优势,通义千问团队进一步利用其强大的技术实力,开发出了基于LLM的视觉AI助手Qwen-VL-Chat。这款产品的出现,使得开发者可以迅速地构建出拥有多模态处理能力的对话应用,极大地提高了工作效率和用户体验。

多模态被视为通用人工智能的关键技术进步路径之一。业内专家普遍认为,相较于仅支持单一感官和文本输入的语言模型,具备多种信息输入功能的多模态模型,其智能潜力巨大,预示着大模型即将实现重大跃升。多模态技术的应用将使大模型对世界的理解更为深入,并极大地拓宽其应用范围。

人类的第一感官能力是视觉,这也是研究者们首先考虑为大型模型赋予的多模态能力。在成功推出M6和OFA系列多模态模型的基础上,阿里云通义千问团队再次开放源代码,推出了基于Qwen-7B的大规模视觉语言模型——Qwen-VL。

Qwen-VL模型作为业内首个具备中文开放域定位能力的通用模型,其强大的开放域视觉定位能力对于提高大模型“视力”的精准度具有重要意义。换言之,该模型能够在画面中精确定位到我们想要寻找的目标,这在机器人操控等实际应用场景中具有至关重要的意义。

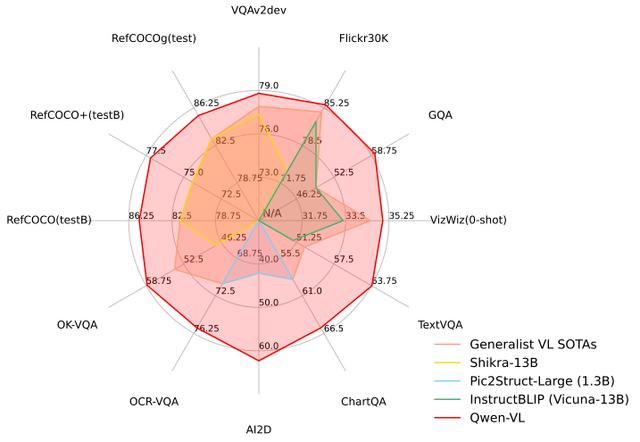

在主流的多模态任务评测和多模态聊天能力评测中,Qwen-VL取得了远超同等规模通用模型的表现。

在四大类多模态任务(Zero-shot Caption/VQA/DocVQA/Grounding)的标准英文评估中,我国团队Qwen-VL实现了与开源LVLM相同表现的最佳成果。为了检验模型在多模态对话场景中的性能,通义千问团队设计了一套基于GPT-4评分系统的“试金石”测试集,用于对比测试Qwen-VL-Chat和其他模型。在中文和英文的对齐评测中,Qwen-VL-Chat都取得了开源LVLM的最佳成绩。

Qwen-VL及其视觉AI助手Qwen-VL-Chat均已上线ModelScope魔搭社区,开源、免费、可商用。用户可从魔搭社区直接下载模型,也可通过阿里云灵积平台访问调用Qwen-VL和Qwen-VL-Chat,阿里云为用户提供包括模型训练、推理、部署、精调等在内的全方位服务。

8月初,阿里云开源通义千问70亿参数通用模型Qwen-7B和对话模型Qwen-7B-Chat,成为国内首个加入大模型开源行列的大型科技企业。通义千问开源模型刚一上线就广受关注,当周冲上HuggingFace趋势榜单,不到一个月在GitHub收获3400多星,模型累计下载量已突破40万。

阿里云, 大规模视觉语言模型, Qwen-VL, 多模态信息理解能力

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!