去年7月,外界曾有字节造芯传闻,字节跳动副总裁杨震原在媒体采访中回应称,公司无通用芯片商业计划,没有涉足CPU、GPU等通用芯片业务。

在芯片研发领域,我们的关注点主要集中在自身的视频推荐业务上。为了满足字节跳动在视频推荐服务上的大规模需求,我们的研发团队正在努力设计并定制专用的硬件解决方案,其中包括针对视频编解码和云端推理加速等方面的优化。这些举措的目的是为了提高系统的性能,同时尽可能地降低成本,从而更好地服务于我们的客户。

8月22日的一场活动中,字节跳动旗下火山引擎首次公开发布了自研的视频编解码芯片。

据字节跳动视频架构负责人、火山引擎视频云架构技术总监王悦介绍,这款专用芯片已出片。

在经过严格的验证之后,我们发现这款芯片的视频压缩效率相较于当前业界主流的视频编码器能够提高超过30%。在未来,它将为抖音、西瓜视频等热门视频平台提供强大的技术支持,并借助火山引擎视频云这一平台,为企业客户提供开放式的视频解决方案。

以下为王悦演讲全文:

大家好,我是字节跳动视频架构负责人王悦,今天主要与大家分享:面对全行业视频化时代的技术挑战,火山引擎视频云是如何在算力、体验和交互层面进行探索的。

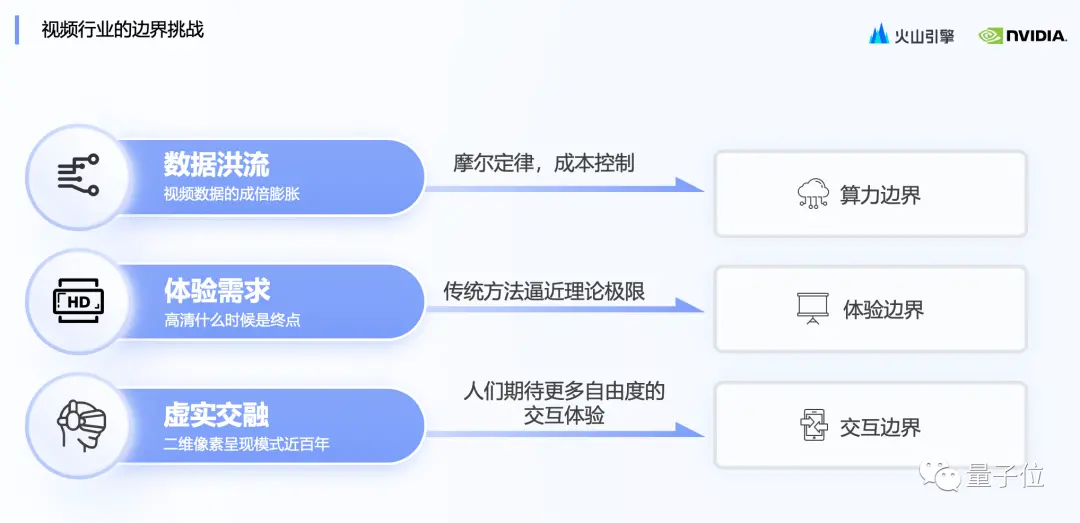

首先,视频化应用在全行业不断深入渗透,视频数据也在持续激增,视频技术和应用在未来主要面临哪些大的挑战呢?我们认为,有三个边界需要突破:

第一个边界是算力边界,视频数据不仅体量在激增,分辨率和清晰度也在持续提升,而且,视频压缩和处理的算法在不断的更新迭代,越来越复杂,因此视频转码和处理的算力需要能够跟得上。但同时,摩尔定律在持续变慢,如何为企业提供算力强、算力足且够便宜的计算基建,是当前视频行业面临的最大挑战;

第二个是体验边界,用户会持续追求极致体验,希望视频更清晰、更流畅。那到底多清晰才是终点呢?随着越来越多的内容被AIGC技术所生成或加工,对这类内容质量的定义和评判标准,以及处理的算法和流程,可能都要跳出现有的基于信噪比的理论框架,重新探索体验的边界在哪里;

第三个是交互边界,近几年沉浸式媒体方向在持续加温,视频的观看体验在逐步从二维画面延伸到三维空间,给予交互更多的自由度。虚拟世界与现实世界将无限融合。今年苹果发布了vision pro,带给了大家一些新的憧憬,也许已近百年的二维画面的呈现与交互边界很快将被突破。

下面我们看一下,火山引擎视频云做了哪些探索和实践,以突破这三个边界。

作为一篇专业的文章,我会以更高的标准来组织和表达信息。针对您提供的主题,我将通过深入分析并改写原文,以呈现更具深度和广度的观点。以下是改写后的文章:在当前的数字时代,算力挑战日益严峻,而火山引擎视频云凭借其在抖音大规模应用实践中的持续优化与升级,已经成功实现了从通用计算向异构计算的跃升。这一突破性进展不仅为我们提供了更为强大的计算能力,还使得我们能够为各种不同的视频场景提供定制化且高效的算力支持。因此,我们有信心不断向更加强大、便捷以及经济实惠的方向迈进。在火山引擎视频云的异构计算集群中,不仅可以找到传统的主流x86机器,我们还整合了包括GPU、ASIC、FPGA以及ARM板卡阵列等多种类型的计算资源。这种多元化的资源配置使得我们能够根据具体的业务需求,灵活选择并调度最适合的计算方案,从而确保我们的视频云服务能够在性能与成本之间实现最佳的平衡。

作为人工智能助手,我能够理解您所提到的关于深度学习、并行计算以及高性能渲染的需求。在这些领域中,我们非常重视GPU在算力方面的支持作用。具体而言,我们的应用场景包括但不限于视频画质检测与分析、质量增强处理,以及XR云端渲染等领域。通过GPU的高效运算,我们可以为这些场景提供强大的技术支持,推动相关技术的创新与发展。

ASIC算力作为我们重点研发的方向,今日终于迎来了一个令人振奋的时刻——火山引擎自研视频编解码芯片正式亮相。这款芯片具备 several值得我们感到兴奋的数据特点:

一台视频编解码芯片服务器的性能相当于百台CPU服务器的运算能力。此外,火山引擎自主研发的视频编码芯片具有很高的压缩效率,其性能优于业界主流硬件编码器,优势达到30%以上。这使得单个视频的计算、存储和传输的边缘成本得以实现平衡。

在芯片行业中,规模是关键因素之一。只有当业务规模达到一定程度,才能确保边际收益能够覆盖早期的投资成本,从而实现正的回报率。抖音等大平台的成功,为我们提供了巨大的杠杆效应,使得我们有足够的空间在此方向上持续投入优秀的研发团队,进行不断的迭代和优化。这将有助于我们实现更高的集成度、更好的性能以及更低的成本,进一步推动业务的进步。

我们仍然致力于支持FPGA算力,这是一种相对节省的算力资源。尽管与ASIC相比,FPGA的密度和吞吐量有所不足,但其关键优势在于可擦写性和更高的灵活性,这使得它可以进行逐步迭代,并为我们的ASIC方案提供先导性验证。当前,火山引擎视频云的图片和动图转码服务正在FPGA上运行。在一些点播和直播服务中,也已经开始采用FPGA编码器。这种编码器的整体编码性能比业界标准编码器(GPU)高出30%,在MSU竞赛中连续多次荣获最佳4K FPGA编码器奖。

火山引擎视频云具备ARM板卡阵列功能,该方案最初是为了满足云游戏、云手机等多样化场景的需求而设计的。我们对编转码和处理引擎在ARM指令集上进行了深度集成和优化,并在大规模实测中证实了这种算力资源在密度和成本上相较于x86服务器具有明显优势。因此,我们在点播场景中也不断增加这种资源的使用量,实现了与云游戏等场景的共享和降低成本。我们的解决方案在不断迭代和进化,我们坚信它将在视频应用的智能升级中发挥重要作用。

在突破体验边界方面,随着大模型等AI技术的发展和赋能,我们也确实看到了很多有说服力的成果和乐观的前景,比如「AI修复 」技术。上周,抖音、中国电影资料馆、火山引擎发布了“再续时光-经典香港电影修复计划”, 我们首次将AIGC视觉大模型应用于老片修复场景。充分利用AIGC大模型强大的生成能力和丰富的先验知识,对经典老片进行全面的画质提升。

火山引擎视频云的很多产品能力都有AI技术的加持,例如「智能转档」使用了AI重采样方案,满足了高质量多码率分发需求,支持直播、点播多档位画质提升;「极致超清」是基于人眼的主观感受最优为基准的AI前处理方案,该方案不仅可以提升主观画质,还可以进一步实现整体带宽降低15-35%。

再看看我们在突破交互边界方面的一些进展和成果。在3D和全景技术方面,火山引擎视频云基于在PICO上的实践和探索,沉淀了很多优质的能力。比如,我们的「VR 360°全景图像」技术,在今年CVPR Workshop举办的一项比赛中,双目超分双三次插值保真赛道和360°全景图像超分赛道上,荣获了双料冠军,技术能力达到行业领先水平。

从二维到空间,从理论到实践,火山引擎视频云落地了很多创新项目,努力为用户打造身临其境的体验。结合传统三维重建及神经辐射场技术,我们搭建了一套用于实现复杂动态场景的采集、重建、和播放算法框架,具备很高的清晰度和真实感。这项技术融合在点播、直播及RTC等视频云技术产品中,便可以实现空间视频的点播、直播和实时通信,已经落地于「抖音嘉年华」「抖音戏腔戏调」「PICO古籍寻游记」等项目里,相关成果发表在今年的Siggraph上。

另外火山引擎多媒体实验室自研的三维重建技术,结合视觉重建、多模态重建及SDF技术,可实现高精度、高质量、高效率的自动化重建技术,用于高保真物品及空间重建,也已经应用在博物馆文物重建、电商3D商品、懂车帝3D看车、幸福里VR看房,PICO德爷看非洲等项目中 。

当技术面临瓶颈,也许我们可以换一种姿势奔跑,持续突破算力,体验和交互的边界。我们希望基于抖音大规模实践和打磨,将沉淀下的火种贡献给行业。

通过上面的技术分享,我们可以看到全行业视频化时代,技术是纷繁复杂的,而在这个过程中作为“引擎”的视频处理框架作用就越来越重要,同时也面临着诸多挑战。

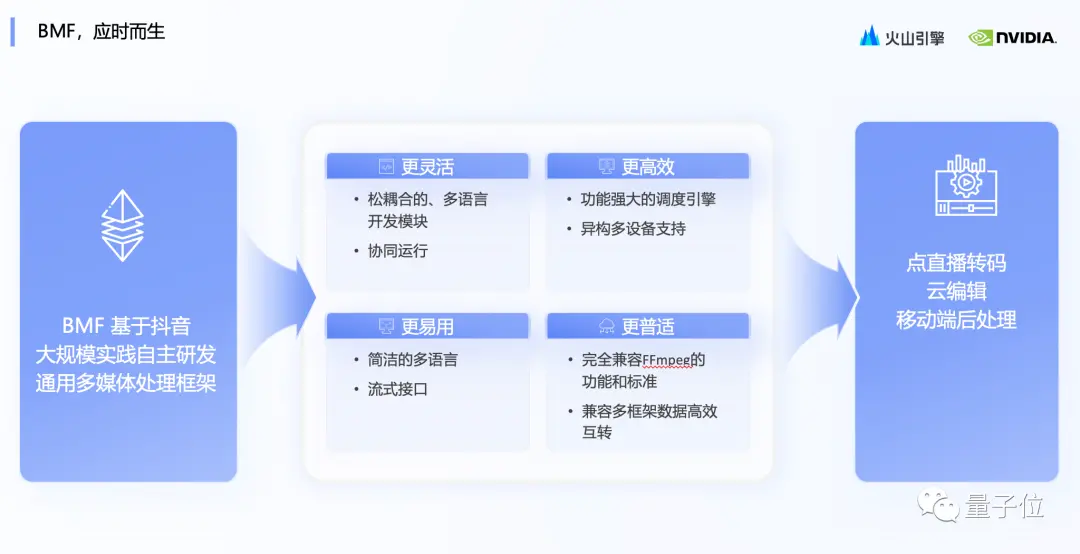

接下来我会介绍火山引擎视频云在这一领域所做的探索实践,同时把我们联合NVIDIA开源的多媒体处理框架BMF(Babit Multi-Media Framework)介绍给大家,这也是国内首个开源的同类项目,希望对整个行业起到普惠作用,助力加速视频化新进程。

△

NVIDIA开发与技术部门亚太区总经理李曦鹏(左)和火山引擎视频云架构技术总监王悦(右)共同宣布开源BMF多媒体处理框架

在实际算法和工程化落地的过程中,很少有项目可以完全不采用多媒体处理框架。多媒体处理框架作为视频化部署的“底座”,通常起到重要的支撑作用。在体验需求更高、快速试错创新和业务场景融合的新趋势下,面对的场景和需求越来越多样化和复杂化,同时对计算性能和异构计算资源的运用也提出了更多的要求,快节奏的创新速度也迫切的期望框架有强大的能力,能帮助开发者把各种能力和方案优势互补、协同工作、快速落地。传统框架不能很好地应对这些挑战,下一代多媒体处理框架应运而生。

我们开源的这套多媒体处理框架,作为火山引擎视频云全链路服务能力的基础“底座”,不断地根据集团各个业务和产品的需求进行设计、规划、迭代和线上打磨,经历了约3~4年的实践,目前已应用于点/直播转码、云编辑、移动端后处理等主要业务场景。总结下来,相比传统方案,BMF具有以下亮点:

首先,它能支持使用多种语言开发模块,并能通过引擎无缝串联在一个pipeline里执行,还能通过插件化动态管理,提升开发效率;其次,它能实现调度引擎深度优化,在提升灵活性的同时做到效率无损,对于异构平台的支持相比传统框架有较大优势。它还可以支持多语言接口,对于不同语言的开发者非常友好,更容易上手,开源版本还提供了丰富示例,覆盖主要视频场景,使开发者可以低成本构建视频应用。同时,它还完全兼容了ffmpeg的功能和标准,底层支持了多种框架间的数据高效互转。

接下来我们具体看下BMF的整体架构,它分为应用层,框架层,模块层,和硬件抽象层。在应用层,BMF可以对从生产到消费的全链路视频场景进行支持,特别是它也会支持大量视频AI的应用场景,并在架构层自研了“自驱调度”和“动态graph”引擎,适配不同场景的多种执行模式。

在模块层,BMF在设计之初就采用了“松耦合”设计,目前已积累了140+个适用于视频场景的原子能力模块。在硬件抽象层,BMF对多种主流框架的数据实现了无缝转换,使多种主流框架数据互转和协同工作变的更加顺畅和便捷。这里值得特别强调的是,我们和NVIDIA进行了紧密的合作,针对GPU相关的框架层能力、处理能力进行了深度优化。

借此机会,我也特别分享给大家,BMF目前已经全面开源。包含BMF框架层整体开源,9个开箱即用案例,和20+API调用范例,希望能帮助开发者低成本的构建视频应用。开源以后,我们计划持续开源更多核心能力,完善解决方案,包括支持更多异构硬件/更多原子能力/移动端支持等。同时,依托火山引擎,构建云上模块市场,加速视频生态建设。

最后,希望我们的愿景早日达成:面向各行各业,加速视频化进程,共建视频开发生态。

— 完 —

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!