上篇文章主要介绍了法律应用场景下精调模型的工程实现方法,其中涉及到了预训练模型和微调(Fine-tuning)等技术。在当前的技术水平下,预训练模型是实现法律应用场景的关键。在预训练阶段,需要使用大量的法律文本进行训练,以获取模型的语料库和语言知识。然后,需要对预训练模型进行微调,使其适应具体的法律应用场景,实现对法律文本的准确理解和处理。本篇文章将重点介绍chatGPT的相关技术优势,并思考chatGPT对法律人工智能的影响。

目前,ChatGPT在法律文书生成、合同审查、法律检索、实体要素抽取、法律咨询等方面还是具有一定的表现。然而,在量刑预测、法律语言的严谨度、专用法律要素提取等方面,该模型与垂直领域厂商的模型还存在差距。因此,ChatGPT在法律领域的应用仍需不断改进和完善。

原因之一是目前chatGPT对法律数据的缺乏,由于学习的不够全面,导致目前使用效果不是很好。从ChatGPT技术发展来超过目前领域模型还是值得期待的,当然会有一个过渡阶段。

我们先了解一下NLP的范式发展经历的两个阶段。

第一个阶段从深度学习到两阶段预训练模型

自2013年引入NLP到2020年5月,GPT3.0的出现让预训练模型的技术发展进入了新的时代。在这一阶段,LSTM和CNN模型的改进成为了特征抽取的关键,同时,Sequence(序列)和Sequence(序列-序列-注意力)Attention(序列-序列-注意力)技术也被广泛运用。这些技术架构为各种具体任务提供了典型的解决方案,如文本分类、命名实体识别、情感分析等。两阶预训练模型BERT和GPT成为了这一阶段的代表模型。BERT模型在文本分类任务中表现优异,并在自然语言处理领域成为了标准模型。GPT模型则能够在各种语言任务中表现出色,如机器翻译、问答系统等。在这一阶段后期,大多数NLP子领域的研发模式都切换到了了两阶段模式。其中,模型预训练阶段成为了应用微调(Fine-tuning)或应用Zero/ Few Shot Prompt模式的关键。这些模式使得研究人员可以更加高效地利用预训练模型进行具体任务,同时也为模型的进一步改进提供了方向。

第二阶段从预训练模型走向通用人工智能

自20年6月GPT3.0出现以来,人工智能经历了从命令式到更符合人的交流方式的转变。这一转变是由“自回归语言模型 Prompting”模式到“自回归语言模型 Instruct”模式的变化引起的。通过这种方式,GPT3.0实现了对自然语言的理解,并能够更好地与人类进行交互。这一变化不仅使人工智能更加人性化,也有助于提高其使用效率和性能。

GPT3.0后有什么优势

市场是靠脚投票,目前规模最大的LLM模型,几乎清一色都是类似GPT 3.0这种“自回归语言模型 Prompting”模式的,比如GPT 3、PaLM、GLaM、Gopher、Chinchilla、MT-NLG、LaMDA等,没有例外。

chatGPT作为“自回归语言模型 Instruct”模式,不仅在形式上统一了自然语言理解和自然语言生成任务的外在表现形式,而且实现了零示例提示语(zero shot prompts)或少数示例提示语(few shot prompts)的自然语言生成任务。

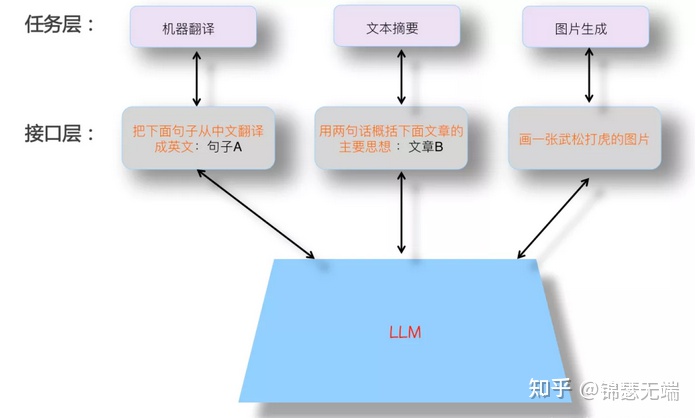

为什么必须用GPT呢,这个需要分析什么是理想的LLM(大语言模型)模型,下图是理想的LLM模式。

理想的大语言模型需要具备以下特点:强大的自主学习能力,解决NLP任何子领域的问题,并不仅仅局限于有限领域。使用人类习惯的表达方式,即理解人类的命令。

GPT是符合理想大语言模型特点

该LLM模型规模巨大,拥有众多参数,具备很强的自学习能力,能够支持多种各领域任务。

第二,无论是零 shot prompts,还是 few shot prompts,或者促进LLM推理能力的思维链(CoT,Chain of Thought)Prompting,都能够实现对人类命令的理解。

chatGPT在法律的应用前景

GPT是可以直接去追求理想LLM模型的,未来的技术发展趋势应该是追求规模越来越大的LLM模型,通过增加法律行业预训练数据的多样性来涵盖越来越多的业务。LLM从法律数据中通过预训练过程学习法律知识,并通过不断增大模型规模来解决问题。研究重心会投入到如何构建这个理想LLM模型,而非去解决法律的具体问题。前期存在GPT与法律领域模型想结合的情况,但随着技术的不断发展,大模型慢慢就不再需要领域模型了。

本内容暂时不讨论可能存在的问题。

关键词:法律应用场景,预训练模型,ChatGPT,技术发展,LLM模型,自回归语言模型,Prompting模式,深度学习,两阶段预训练模型,BERT,GPT,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,法律语言的严谨度,专用法律要素提取,模型微调,Zero/ Few Shot Prompting模式,思维链Prompting模式,深度学习,自回归语言模型,LLM模型,自主学习能力,通用人工智能,模型规模,领域模型,法律数据,预训练阶段,模型微调,Zero/ Few Shot Prompting模式,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,法律语言的严谨度,专用法律要素提取,模型规模,自回归语言模型,Prompting模式,深度学习,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型微调,Zero/ Few Shot Prompting模式,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型规模,自回归语言模型,Prompting模式,深度学习,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型微调,Zero/ Few Shot Prompting模式,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型规模,自回归语言模型,Prompting模式,深度学习,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型微调,Zero/ Few Shot Prompting模式,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型规模,自回归语言模型,Prompting模式,深度学习,自然语言理解,自然语言生成,法律文书生成,合同审查,法律检索,实体要素抽取,法律咨询,量刑预测,模型微调,Zero/ Few Shot Prompting模式,自然语言理解,自然语言生成,