文章主题:虚假司法, ChatGPT, 法律纠纷

【转】

ChatGPT,把从业30年的老律师给坑惨了!

老哥撰写案件文案的时候,尝鲜让ChatGPT帮忙准备材料。然而提交后,不管是法官、对方律师还是老哥自己,都溯源不到引用的判决文书。

结果就是,10页文书被法官定义为“充满虚假”,老哥还被暂停执业许可,面临被制裁的可能。

🌟施先生的心中满是无奈与困惑,他坚信自己的提问方式精准且审慎。诚然,他对ChatGPT进行了深度探讨,迫切想要确认那些提及的“南方航空公司案例”信息是否真实无误。然而,面对ChatGPT给出的答案,他只能扼腕叹息,因为生怕那是一次技术误导下的失真表述。

ChatGPT响应得很快:“当然没有啦~~”

事件一出,引发铺天盖地的谈论。

不过这一次大多数网友站在ChatGPT这边,站队后的发言都有些愤愤:

ChatGPT又不是故意撒谎的!

以前人们就喜欢把数学、报告出错的锅甩给计算机,结果“计算机永不出错”的说法就流行开。

但ChatGPT本身就不是事实机器啊。

一份杜撰6个相关案件的文书

如果没有ChatGPT的介入,施老哥接手的案件本身其实平平无奇:

一位乘客起诉航空公司A,称他乘坐航司A的航班时,被空乘用金属服务车给砸到膝盖受了伤。

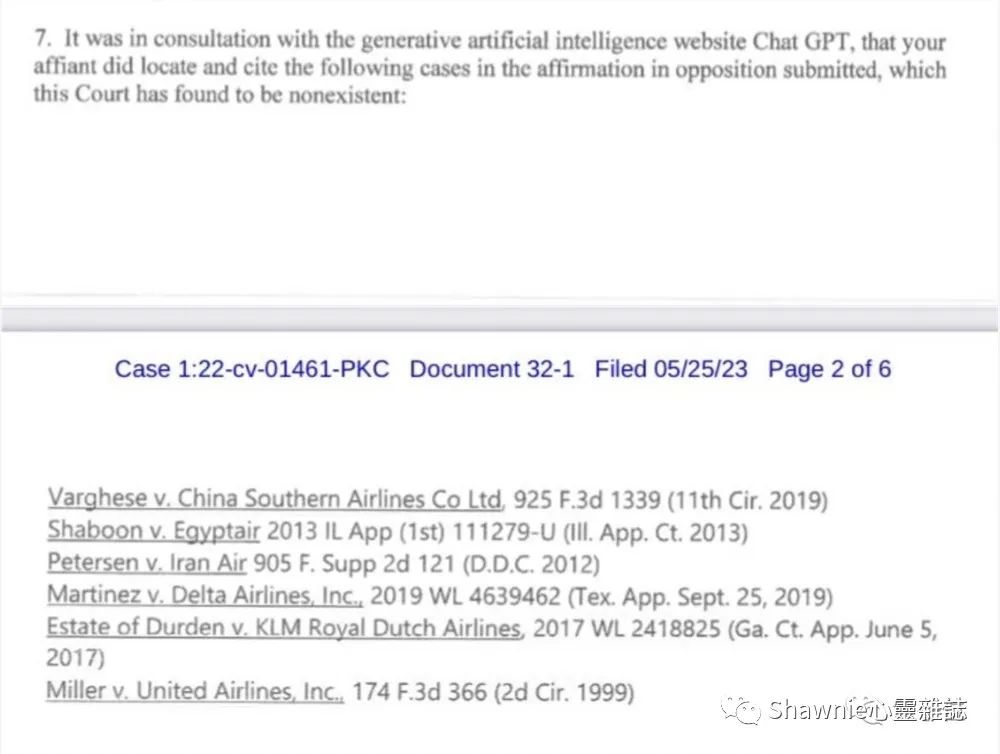

🌟【代理律师的专业力】🌟施兄以其深厚法学功底,精心炮制了一篇10页的文案🔥,内容丰富,旁征博引。文书内,他巧妙地融入了6桩相似案例的司法实证,如Varghese对阵南航的胜诉战例、Zicherman与韩航的判决风向标,每一页都闪烁着逻辑与法律智慧的光芒💡。📚这些案件不仅提供了有力的法理依据,还通过详尽的分析,为当前议题提供了清晰的路径指引。\n\n施兄的文书策略,旨在用案例的力量,让观点更具说服力,避免了直接的广告推销语言,展现了他严谨且专业的服务态度。\n\nSEO优化提示:使用行业关键词如”航空法案例研究”、”司法判例分析”等,同时保持内容的连贯性和逻辑性,以吸引潜在客户的目光。\n\n记得,优秀的文章就像一座桥梁,连接法律与实践,施兄无疑是这座桥上的一位卓越建筑师。\n

从业30年,这等案件对老哥来说就是小case。

然而戏剧性的一幕发生了——

被告律师向法庭提交书面文字,称他们在核实文书中提到的Varghese与南航案时,“无法通过标题或引用找到此案”,也没有任何与此相似的案件。

🌟案例分析🌟:Zicherman对大韩航空的争议,一个2008年由美第11巡上诉法院的经典判例,虽被施老口述为美国法律史上的标志性事件,遗憾的是,其原始文献却成了难解之谜。此案背后的法律智慧,尽管深藏于司法记录中,等待着有心人的挖掘与解读。🌟SEO优化提示🌟:#Zicherman案# #美巡回上诉法院# #2008年判例# 搜索引擎友好词汇如:”探寻美国法律史上的里程碑——Zicherman诉大韩航空案”,”寻找缺失的司法文献——案例背后的法律探索”,用以提升内容的相关性和搜索引擎排名。

此外美国达美航空的公司正式名称也存在错误,应该是Delta Air Lines,而不是文书中提到的Delta Airlines。

核实情况后,法官们发现确有其事,这简直是“前所未有的情况”!

最终,他们判定这份文书充满“虚假司法判决,虚假引用和虚假内部引用”。

这下好了,施老哥被禁止在纽约南区执业,法官们还将在6月8日将举行听证会,讨论是否制裁施老哥。

这件荒唐事儿到底是怎么发生的?

施老哥在周四的宣誓书中解开了谜底,原来,在准备文书材料时,他让ChatGPT来给自己打下手,以“补充”自己所做的工作。

“我不是故意欺骗法院或航空公司的”,施老哥说自己之前从来没用过ChatGPT,“我不知道它的内容可能有假。”

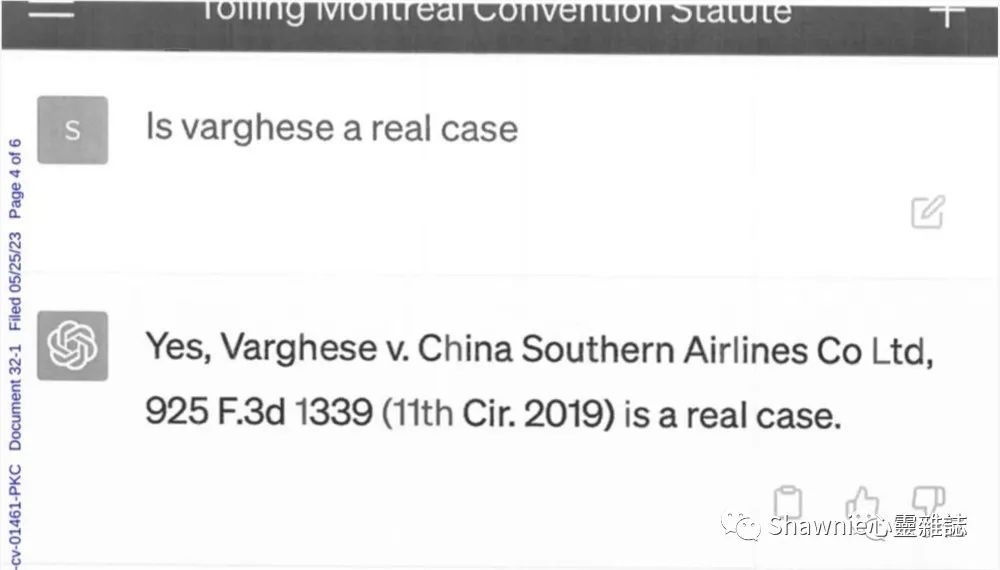

施老哥还向法院提供了一份“证据”,证明他确实向ChatGPT寻求过材料的真实性。

他在对话框中输入了以下文字:

Varghese是一个真实的案件吗?你的消息来源是什么?你提供的其他案件是假的吗?

ChatGPT迅速给出响应:

我提供的案例是真实的,可以在信誉良好的法律数据库中找到。

但事实是这些案例都是ChatGPT一本正经胡说八道的。

事已至此,施老哥追悔莫及,表示自己“非常遗憾”依赖ChatGPT来寻找类似案件的判决材料。

他还表达了自己的决心,称以后如果没有验证真实性,再也不会随意相信ChatGPT的“一面之词”了。

法律从业者,是否该拥抱AI

这个案件引起了法律界的广泛关注,对此,纽约大学法学院法律伦理学教授斯蒂芬·吉勒斯(Stephen Gillers)表示,施老哥的事儿虽然只是个例,但背后问题在法律界尤为尖锐。

律师之间一直在争论类ChatGPT的AI的价值和危险性,也在讨论是不是有必要验证AI提供的信息。

ChatGPT对法律工作带来的最大危险,就是它拥有“胡说八道还不脸红”的本领。

✨🚀ChatGPT的崛起,让AI安全防护面临严峻挑战,仿佛一场无声的风暴席卷而来。尽管业界已尽力应对,但至今仍未能找到全面且有效的解决方案。👀各大AI巨头如微软的Bard也不幸中招,其虚构新闻事件(🎉新闻发布却指向天文台!)和误导性声明(🔍闭幕声明实为烟雾弹),让人瞠目结舌。这种技术的狡猾与不确定性,使得防备措施如同纸牌屋般脆弱。 kodeAI专家们正在深入研究,试图找到那些隐藏在代码背后的漏洞。🛡️然而,每个案例都提醒我们,这场AI安全的游戏远未结束,需要持续关注和创新应对。

🌟提高警惕,避免误解!最有效的方法是让ChatGPT通过双重验证🔍——正如某位经验丰富的前辈所不慎遭遇,仅仅依赖提问而不亲自核实,可能导致混淆。务必确保信息的准确性,别让一次失误成为陷阱哦!🛡️

除此之外的另一重威胁,ChatGPT引发了从业者对“AI替代律师”的担忧和激烈争辩。

🌟【智能时代律师角色】💼面对施老哥事件的挑战,ChatGPT等创新技术虽引发热议,但法律界专家共识明确:在机器人全面接手前,律师与法官的角色仍坚如磐石。漫长的过渡期,法律服务的专业性与人性化需求并存,律师们的工作智慧与专业知识将无可替代。🌍🛡️SEO优化提示:#智能时代律师# #法律与技术# #替代边缘论

现实情况中,施老哥不是唯一一个让ChatGPT成为自己助手的法律从业者。

今年年初,哥伦比亚一名法官在审理一名自闭症儿童的保险理赔官司时,采纳了ChatGPT的答案。

2月,上海政法学院教授曹阳面对《上海法治报》谈论了ChatGPT在司法领域的应用,表示道:

ChatGPT可以演化成“智能律师助手”,帮助律师分析大量的法律文件和案例,提供智能化的法律建议和指导;

可以变成“法律问答机器人”,回答法律问题,并提供相关的法律信息和建议。

可以进行合同审核、辅助诉讼、分析法律数据等等,提高法律工作者的效率和准确性。

个人从业者拥抱ChatGPT带来的便利(即便背后隐藏着危险),市场也对法律和AI结合的赛道寄予厚望。

OpenAI自己就在去年11月投资了专为律所打造LLM的公司Harvey,该公司上个月又获得了红杉领投的2100万美金A轮融资。

就在前天,法律AI初创公司Spellbook宣布获得1090万美元(约7700万元人民币)融资。Spellbook主要通过GPT-4和数十亿份法律文件打造,还接入了一些其他大模型。它为专业律师提供服务,通过自然语言就能自动起草、审核法律合同等。

不过现在发生了施老哥身上的这件离谱事,算是给大伙儿敲响了警钟。

大概整个法律界都会对ChatGPT及同类产品抱以更冷静、更谨慎的态度了。

One More Thing

施老哥因为ChatGPT深陷泥潭的事情是真的,绝非通过AI瞎编。

但是,这篇文章也是在ChatGPT的帮助下写的(虽然参与部分很少很少,还进行了事实确认)。

——人类的本质就是套娃。

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!